Nos últimos anos, a transformação digital tem impulsionado avanços significativos na forma como gerenciamos e implantamos aplicações de software. Entre essas inovações, os containers surgiram como uma alternativa revolucionária às tradicionais máquinas virtuais, trazendo maior agilidade, eficiência e escalabilidade. Para compreender completamente o impacto e as possibilidades que essa tecnologia oferece, é fundamental entender o conceito de containers, com destaque especial ao Docker, uma das plataformas líder no mercado.

Definição de Containers e Docker

Containers são unidades leves e portáteis de software que encapsulam uma aplicação juntamente com suas dependências, configurações e bibliotecas necessárias para sua execução. Diferente de uma máquina virtual, que replica um sistema operacional completo, os containers compartilham o núcleo do sistema operacional do host, resultando em processos isolados, porém mais rápidos e menos pesados.

O Docker, introduzido em 2013, consolidou-se como uma plataforma padrão para a criação, distribuição e gerenciamento de containers. Sua popularidade se dá pela facilidade de uso, suporte a múltiplas plataformas e uma vasta comunidade de desenvolvedores. Com o Docker, é possível criar ambientes de desenvolvimento idênticos aos de produção, facilitando testes, integração contínua e implantação.

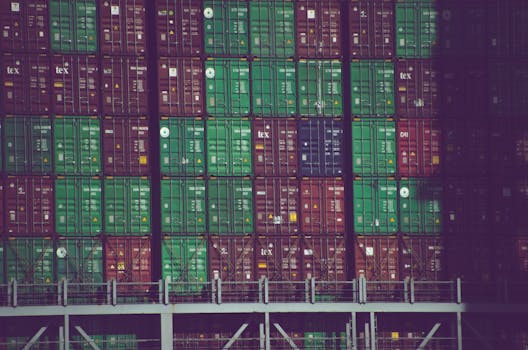

Origem e analogia com containers físicos

Para entender melhor o conceito, podemos recorrer a uma analogia simples: os containers utilizados na indústria naval. Assim como um container marítimo padronizado facilita o transporte de cargas entre navios, caminhões e armazéns, os containers de software padronizam a entrega de aplicações. Essa padronização permite maior rapidez e segurança na movimentação dos produtos, minimizando riscos e garantindo compatibilidade entre diferentes ambientes.

Essa comparação evidencia como a virtualização de softwares evoluiu e tornou-se mais eficiente através da tecnologia de containers. Ao invés de configurar manualmente ambientes específicos para cada projeto, os desenvolvedores podem criar containers que funcionam em qualquer sistema, independentemente do hardware ou do sistema operacional subjacente.

Funcionamento dos containers de software

Os containers funcionam através do empacotamento do código da aplicação juntamente com suas bibliotecas, dependências e configurações necessárias para sua execução. Essa combinação garante consistência e portabilidade, permitindo que o container rode de maneira idêntica em diferentes ambientes de desenvolvimento, testes ou produção.

Para alcançar essa eficiência, o Docker utiliza recursos do kernel do sistema operacional do host, como cgroups e namespaces, para isolar recursos e processos. Essa abordagem proporciona isolamento, segurança e gerenciamento eficiente de recursos, ao mesmo tempo em que mantém o consumo de memória e CPU bastante reduzido em comparação às máquinas virtuais.

Vantagens do uso de containers

- Rapidez na implantação: containers podem ser iniciados em segundos, acelerando os processos de deployment.

- Isolamento de ambientes: cada container opera de forma independente, evitando conflitos de dependências.

- Facilidade na replicação: ambientes podem ser facilmente clonados, garantindo consistência.

- Economia de recursos: menor consumo de CPU e memória em relação às máquinas virtuais.

- Portabilidade: containers funcionam de forma semelhante em diferentes plataformas e provedores de nuvem.

Essas vantagens têm feito do Docker uma ferramenta indispensável para equipes de desenvolvimento e operações, promovendo uma maior agilidade na entrega de software e uma gestão de infraestrutura mais eficiente.

Para quem busca aprimorar seus conhecimentos e implementar containers no seu ambiente de TI, a plataforma da Valuehost oferece soluções de hospedagem otimizadas para esse tipo de tecnologia, garantindo desempenho, segurança e facilidade de gerenciamento.

Funcionamento dos containers de software

Os containers de software operam através de uma abordagem modular, onde o código da aplicação, suas dependências, bibliotecas e configurações específicas são empacotados em uma única unidade de execução. Esse empacotamento garante que o ambiente seja consistente e reproduzível, independentemente do sistema operacional ou hardware onde o container será executado. Para isso, o Docker utiliza recursos avançados do kernel do sistema operacional host, como cgroups e namespaces.

Os cgroups (control groups) são responsáveis por limitar, contabilizar e isolar o uso de recursos como CPU, memória, disco e rede entre diferentes containers. Já os namespaces criam ambientes de isolamento, garantindo que processos dentro de um container não tenham acesso ou impacto sobre processos em outros containers ou no sistema host. Essa combinação permite que cada container seja uma entidade isolada, com seu próprio sistema de arquivos, rede, processos e configurações, embora compartilhe o núcleo do sistema operacional do host.

Outro aspecto importante do funcionamento do Docker está na sua capacidade de usar imagens, que são modelos estáticos de containers pré-configurados. Essas imagens podem ser criadas a partir de um Dockerfile, um arquivo que define passo a passo como montar o ambiente desejado, especificando softwares, dependências e comandos de inicialização. Uma vez criada, a imagem pode ser distribuída e executada em qualquer ambiente compatível, garantindo que o resultado seja idêntico em diferentes locais.

Ao iniciar um container, o Docker utiliza a imagem correspondente e instancia uma cópia de leitura e gravação baseada nela, chamada de container em execução. Essa separação entre imagem e container em execução proporciona elasticidade para clonar, escalar ou remover ambientes de maneira simples e rápida, mantendo a eficiência no uso de recursos.

Vantagens do uso de containers

- Rapidez na implantação: a inicialização de containers costuma ocorrer em poucos segundos, facilitando deploys freqüentes e rápidos.

- Isolamento de ambientes: cada container funciona de forma independente, o que previne conflitos de dependências e configurações entre aplicações.

- Facilidade na replicação: ambientes podem ser duplicados facilmente, facilitando testes, escalabilidade e backups.

- Economia de recursos: por compartilharem o núcleo do sistema operacional, os containers utilizam significativamente menos CPU e memória do que as máquinas virtuais tradicionais.

- Portabilidade: containers funcionam de maneira uniforme em diferentes plataformas, incluindo diferentes provedores de nuvem e ambientes on-premises.

Essas características fazem do Docker uma ferramenta essencial para o desenvolvimento moderno de software, especialmente na implementação de metodologias como DevOps, integração contínua e integração contínua, ao fornecer ambientes consistentes e escaláveis de forma eficiente.

Para empresas que buscam aprimorar sua infraestrutura de TI, plataformas como a oferecida pela Valuehost oferecem suporte especializado para hospedagem, monitoramento e gerenciamento de ambientes baseados em containers, garantindo desempenho, segurança e facilidade de escalabilidade. Essas soluções possibilitam que equipes de desenvolvimento entreguem aplicações mais rapidamente, com maior confiabilidade, tudo com o suporte de uma infraestrutura robusta e preparada para o futuro.

Implementação de microsserviços com containers

A adoção de containers transformou radicalmente a maneira como empresas desenvolvem, implementam e gerenciam microsserviços. A modularidade que os containers oferecem possibilita dividir aplicações complexas em componentes menores, independentes e facilmente escaláveis. Cada microsserviço pode ser executado em seu próprio container, o que facilita a manutenção, atualização e deploy sem afetar o sistema como um todo.

Ao utilizar essa arquitetura, equipes de desenvolvimento podem acelerar o ciclo de vida do software, promove maior autonomia às equipes de trabalho e melhora a resiliência geral do sistema. Além disso, a compatibilidade entre ambientes de testes, homologação e produção é garantida, reduzindo falhas decorrentes de diferenças ambientais.

Considerações sobre a adoção de containers

Antes de integrar containers ao ambiente de TI, é importante avaliar alguns fatores essenciais. Compatibilidade: verificar se as aplicações e sistemas existentes podem ser facilmente migrados ou integrados aos containers, considerando dependências e requisitos específicos.

Segurança: implementar práticas de segurança na configuração, gerenciamento de acessos e atualização contínua das imagens de containers, minimizando riscos de vulnerabilidades.

Gerenciamento: utilizar plataformas de orquestração, como o Kubernetes, para automatizar a implantação, escalonamento e manutenção dos containers, garantindo alta disponibilidade e resiliência.

Também é fundamental estabelecer processos de monitoramento e backup, além de treinar equipes técnicas na cultura DevOps para maximizar os benefícios dessa tecnologia.

Futuro e impacto da tecnologia de containers

O futuro dos containers traz promessas de maior automação, inteligência e integração com tecnologias emergentes. A crescente adoção de orquestradores, como o Kubernetes, amplia a capacidade de gerenciar ambientes complexos com milhares de containers de forma eficiente.

Além disso, a expansão do uso de containers na nuvem promete oferecer maior flexibilidade de implantação e custos otimizados, permitindo que empresas escalem suas aplicações de forma ágil e segura. A evolução contínua das ferramentas e a padronização dos procedimentos consolidam os containers como uma componente indispensável na infraestrutura moderna de TI.

Para as organizações que desejam manter-se competitivas nesta nova era digital, investir na compreensão e implementação de containers é uma estratégia essencial, alinhando-se às tendências de inovação tecnológica e eficiência operacional.

Facilidades de gerenciamento e orquestração de containers

Com a crescente adoção de containers em ambientes corporativos, o gerenciamento eficiente e a orquestração de grandes volumes de containers tornaram-se essenciais. Ferramentas como Kubernetes, Docker Swarm e OpenShift surgiram para automatizar tarefas como implantação, escalonamento, atualização e monitoramento de containers. Essas plataformas proporcionam alto nível de controle, garantindo disponibilidade contínua e resiliência do sistema, especialmente em aplicações que demandam alta escalabilidade.

No ecossistema Docker, o Docker Compose também ganha destaque, pois facilita o gerenciamento de ambientes multicontainers, definindo configurações complexas de forma simples através de arquivos YAML. Essa ferramenta permite que desenvolvedores levem ambientes de teste e desenvolvimento de forma rápida e consistente, alinhando-se às práticas de DevOps e CI/CD.

Além disso, a integração com plataformas de cloud computing, como AWS, Google Cloud e Azure, amplia as possibilidades de implementação. Essas nuvens oferecem serviços gerenciados de orquestração de containers, deixando as equipes mais focadas na lógica de negócio e menos na infraestrutura, ao mesmo tempo em que oferecem alta disponibilidade, balanceamento de carga e escalabilidade automática.

Para empresas que desejam uma gestão integrada e eficiente, plataformas de orquestração oferecem dashboards intuitivos, integrações com pipelines de CI/CD e funcionalidades de segurança avançadas. Dessa maneira, é possível garantir que toda a infraestrutura baseada em containers funcione de maneira coordenada, automatizada e segura, promovendo maior agilidade na entrega de aplicações e na adaptação a demandas variáveis.

Segurança, monitoramento e manutenção de containers

A adoção de containers também exige atenção especial às práticas de segurança. Como cada container compartilha o núcleo do sistema operacional do host, vulnerabilidades podem se propagar se não houver controle adequado. Assim, é fundamental manter as imagens atualizadas, utilizar scanners de vulnerabilidades, implementar políticas de acesso rígidas e configurar redes segmentadas, isolando ambientes críticos.

Para garantir a saúde operacional, o monitoramento contínuo dos containers é imprescindível. Ferramentas como Prometheus, Grafana e ELK Stack oferecem visibilidade em tempo real dos métricos de desempenho, uso de recursos e eventuais falhas. Essas soluções ajudam na detecção precoce de problemas, na análise de logs e na otimização dos recursos, contribuindo para uma gestão proativa e eficiente.

Outra prática importante é a automação de backups de volumes persistentes e configurações, assegurando a continuidade dos serviços mesmo em casos de falhas ou ataques. Além disso, a implementação de políticas de atualização contínua das imagens, combinada com testes automatizados, garante que o ambiente de containers esteja sempre protegido e atualizado.

Integração com estratégias DevOps e infraestrutura como código

A combinação de containers com metodologias DevOps potencializa a agilidade e a colaboração entre equipes de desenvolvimento e operações. Ao usar containers como unidade padrão, é possível implementar pipelines automatizados de integração contínua e entrega contínua (CI/CD), reduzindo o tempo entre o desenvolvimento e a produção.

O uso de ferramentas de infraestrutura como código, como Terraform e Ansible, complementa essa estratégia ao permitir a automação completa da criação, configuração e gestão de ambientes. Dessa forma, toda a infraestrutura baseada em containers pode ser versionada, auditada e reproduzida de forma simples, garantindo maior controle e rastreabilidade.

Em um cenário ideal, a combinação de containers, orquestração, CI/CD e infraestrutura como código cria um ciclo de desenvolvimento extremamente eficiente, capaz de responder rapidamente às mudanças de mercado, aprimorar a experiência do usuário e manter a segurança e a estabilidade do sistema.

Para equipes de TI em busca de suporte técnico especializado, plataformas de hospedagem que oferecem suporte completo para ambientes de containers, como as soluções da Valuehost, facilitam a implementação de estratégias modernas. Assim, a infraestrutura é otimizada para desempenho, segurança e gestão automatizada, permitindo maior foco na inovação e nos resultados.

Gerenciamento de configuração e automação com Docker

Um aspecto fundamental para maximizar os benefícios do uso de containers é a adoção de práticas de automação e gerenciamento de configuração. Ferramentas como Docker Compose, Ansible, Terraform e Kubernetes oferecem recursos avançados para orquestrar ambientes complexos, automatizar implantações, atualizações e escalonamentos. O Docker Compose, por exemplo, é altamente útil em ambientes de desenvolvimento, permitindo definir múltiplos containers interdependentes em um único arquivo YAML, facilitando a replicabilidade e versionamento.

Já o Kubernetes surge como plataforma de orquestração padrão para ambientes de produção, especialmente quando se trata de gerenciar milhares de containers distribuídos em múltiplos nós. Sua capacidade de automatizar o balanceamento de carga, escalabilidade, atualização contínua e recuperação automática torna-o indispensável para operações de grande escala. Ferramentas de infraestrutura como código, como Terraform, permitem a criação e gerenciamento de recursos de nuvem de forma reproducível, garantindo controle e rastreabilidade.

A integração dessas ferramentas forma um ciclo virtuoso de entrega contínua: desde a codificação até a produção, a automação reduz erros, aumenta a velocidade das implantações e melhora a governança dos ambientes. Empresas que adotam essas práticas podem responder rapidamente às mudanças do mercado, ajustando suas aplicações e infraestrutura de forma ágil, segura e eficiente, além de otimizar recursos operacionais e reduzir custos.

Segurança, monitoramento e manutenção de containers

Garantir a segurança em ambientes de containers é uma prática que demanda atenção contínua. Como os containers compartilham o núcleo do sistema operacional do host, vulnerabilidades no kernel ou nas imagens podem afetar múltiplos ambientes simultaneamente. Assim, é fundamental manter as imagens sempre atualizadas, realizar varreduras com scanners de vulnerabilidades e aplicar políticas de acesso restritivas, como redes segmentadas e controles de identidade.

Além disso, o monitoramento em tempo real é vital para identificar gargalos, falhas ou atividades suspeitas. Ferramentas como Prometheus, Grafana e ELK Stack fornecem dashboards detalhados de uso de recursos, métricas de desempenho, logs de atividades e alertas automáticos. Essas informações facilitam ações proativas, minimizando o impacto de incidentes e otimizando a performance do sistema.

Outra prática indispensável é a automação de backup de volumes persistentes, garantindo a integridade e disponibilidade dos dados críticos. Isso, aliado a atualizações contínuas das imagens, testes automatizados e gerenciamento de patches, garante que os ambientes estejam protegidos contra ameaças externas e vulnerabilidades internas.

Integração com estratégias DevOps e infraestrutura como código

A utilização de containers promove uma sinergia natural com metodologias DevOps, que visam integrar desenvolvimento, operações e infraestrutura através de automações. Com containers como unidade padrão, é possível criar pipelines de CI/CD que automatizam testes, validações e deploys, acelerando o ciclo de inovação com maior confiabilidade.

Ferramentas de infraestrutura como código, como Terraform e Ansible, complementam essa estratégia ao permitir a automação de provisão e configuração de ambientes de forma versionada, auditável e reproduzível. Com essa abordagem, toda a infraestrutura baseada em containers pode ser gerenciada de modo controlado, facilitando rollback, escalabilidade dinâmica e conformidade.

Essa combinação cria um ciclo de entrega contínua (CD) e integração contínua (CI) altamente eficiente, podendo responder rapidamente às mudanças do mercado, ajustar recursos de forma ágil e manter alta segurança e desempenho na infraestrutura de TI.

Para empresas que desejam manter vantagem competitiva, o suporte de plataformas de hospedagem que oferecem soluções completas de gerenciamento de containers, integradas a serviços de automação, é decisivo. Essas plataformas agregam desempenho, segurança e facilidade de gestão, potencializando a inovação e o ciclo de vida de seus softwares.

Automatização de testes e deploy com containers

Astrictura de containers facilita a implementação de pipelines de integração contínua (CI) e entrega contínua (CD). Como essas unidades encapsulam ambientes de execução padronizados, equipes podem automatizar a validação, testes e implantação de aplicações de forma confiável. Ferramentas como Jenkins, GitLab CI, CircleCI e outros orquestram o ciclo de vida do software, garantindo que cada versão do código passe por processos automatizados antes de chegar ao ambiente de produção.

Ao usar containers, os testes podem ser realizados em ambientes idênticos aos de produção, reduzindo problemas de inconsistência que normalmente ocorrem devido às diferenças de configuração entre ambientes. Essa prática aumenta a confiança nas liberações, reduz o tempo de entrega e minimiza riscos operacionais.

Ferramentas complementares para gerenciamento de containers

Para gerenciar ambientes compostos por múltiplos containers, plataformas como Kubernetes, Docker Swarm e OpenShift oferecem recursos avançados de orquestração e automação. O Kubernetes, por exemplo, organiza os containers em pods, realiza instalação, atualizações, balanceamento de carga e recuperação automática de falhas, garantindo alta disponibilidade mesmo em cenários de grande escala.

Além disso, o uso de ferramentas de gestão de configuração e infraestrutura como código, como Terraform e Ansible, permite automatizar toda a infraestrutura de suporte aos containers. Essas soluções oferecem controle de versão, rastreamento de mudanças e maior segurança na configuração de ambientes multi-cloud ou híbridos.

Segurança e melhores práticas na gestão de containers

Garantir a segurança dos ambientes baseados em containers envolve múltiplas ações. Manter as imagens atualizadas e realizar varreduras com scanners de vulnerabilidade é fundamental para mitigar riscos de exploits. Políticas de controle de acesso, segmentação de redes internas e uso de firewalls segmentados protegem ambientes críticos contra acessos não autorizados.

Além disso, o monitoramento contínuo de recursos, desempenho e logs permite uma gestão proativa. Ferramentas como Prometheus, Grafana, ELK Stack e Falco fornecem visibilidade em tempo real e ajudam a detectar atividades suspeitas ou anomalias.

A automação de backup de volumes persistentes garante a integridade de dados essenciais, enquanto atualizações frequentes das imagens reforçam a segurança e trazem melhorias constantes ao ambiente.

Impactos na transformação digital e na infraestrutura moderna de TI

O avanço da tecnologia de containers impacta profundamente a forma como as organizações pensam sua infraestrutura de TI. Seus benefícios de agilidade, escalabilidade e menor consumo de recursos propiciam ambientes mais flexíveis, que se ajustam rapidamente às mudanças de mercado e às demandas dos clientes.

Ao permitir a implementação de arquiteturas descentralizadas, como a de microsserviços, a virtualização através de containers torna-se uma peça-chave na estratégia de inovação contínua. Essa abordagem reduz o time de entrega, aumenta a resiliência dos sistemas e promove uma cultura de automação, alinhada às metodologias DevOps.

Conclusão

O entendimento aprofundado sobre containers e Docker é essencial para qualquer profissional ou organização que busca modernizar suas operações de TI. Esses recursos proporcionam uma nova dimensão na virtualização, permitindo ambientes mais leves, rápidos e seguros, além de promover maior colaboração entre equipes de desenvolvimento e operações. Com o suporte de plataformas como a oferecida pela Valuehost, é possível aproveitar toda a potencialidade dessa tecnologia com uma infraestrutura robusta, segura e pronta para o futuro, promovendo inovação e competitividade sustentável.

Integração com estratégias DevOps e infraestrutura como código

A adoção de containers como parte integrante do ciclo de desenvolvimento de software apresenta benefícios consideráveis na agilidade, resiliência e qualidade das aplicações. Uma das principais vantagens é a facilidade de integração com fluxos de trabalho DevOps, que promovem a colaboração entre equipes de desenvolvimento, operações e testes mediante automação, padronização e rápida entrega de novas versões.

Ferramentas de infraestrutura como código (IaC), como Terraform, Ansible e Pulumi, possibilitam criar, modificar e gerenciar ambientes de forma automatizada, versionada e auditável. Quando combinadas com plataformas de orquestração como Kubernetes, estas ferramentas garantem que a infraestrutura de suporte aos containers seja reproduzível, escalável e compatível com diferentes provedores de nuvem ou ambientes on-premises.

Essa sinergia permite que toda a infraestrutura, desde servidores físicos até componentes de rede e armazenamento, seja tratada como código, facilitando o rollback de mudanças, testes de configurações e manutenção preditiva. Assim, o ciclo de desenvolvimento e implantação passa a ser contínuo, com processos bem definidos, integrados e automatizados, reduzindo o risco de erros humanos e aumentando a velocidade de resposta às demandas do mercado.

Impacto na inovação digital e na modernização da infraestrutura de TI

O avanço dos containers tem transformado profundamente a infraestrutura de TI das organizações, promovendo ambientes mais flexíveis, ágeis e eficientes. Ao facilitar a implementação de arquiteturas baseadas em microsserviços, essa tecnologia permite que empresas inovem com maior rapidez, respondendo de forma dinâmica às mudanças de mercado e às solicitações dos clientes.

Além disso, a utilização de containers na nuvem e em híbridos garante escalabilidade sob demanda, otimização de custos e maior resiliência operacional. Essa evolução possibilita a criação de ambientes virtuais altamente disponíveis, com recuperações automáticas, upgrades contínuos e alta segurança, promovendo uma cultura de inovação contínua.

Perspectivas de futuro e tendências

O cenário para os containers aponta para uma integração cada vez maior com inteligência artificial, automação avançada e estratégias de multicloud. O uso de orquestradores como Kubernetes continuará a evoluir, apresentando recursos de autoescala, gerenciamento de atualizações sem downtime, segurança reforçada e gerenciamento de grandes ambientes de forma transparente.

A adoção de containers também será ampliada em setores que demandam alta conformidade, segurança e governança, com a implementação de políticas automatizadas de compliance e auditoria. Além disso, a padronização de imagens, a adoção de registries privados com controle de acesso e a inovação em soluções de monitoramento e gestão contribuirão para ambientes mais seguros, visíveis e eficientes.

Para empresas de todos os tamanhos, investir na compreensão e implementação de containerização se mostra um diferencial estratégico para manter a competitividade e impulsionar a transformação digital.

Implementação de microsserviços com containers

A utilização de containers na arquitetura de microsserviços reconhecidamente aumenta a agilidade, a escalabilidade e a facilidade de manutenção dos sistemas. Com a capacidade de dividir aplicações complexas em componentes menores, independentes e autossuficientes, as equipes de desenvolvimento podem trabalhar em ciclos mais curtos, promovendo entregas contínuas e rápidas. Cada microsserviço pode ser empacotado em seu próprio container, facilitando seu gerenciamento, atualização e implantação de forma isolada, sem impacto no restante do ecossistema.

Ao implementar microsserviços com containers, a autonomia das equipes é potencializada, permitindo que diferentes grupos possam desenvolver, testar e escalar suas partes de forma independente, assegurando que pequenas alterações possam ser entregues com maior frequência e menor risco de falha. Isso também favorece a resiliência do sistema, pois a falha de um microsserviço não compromete todo o ambiente, possibilitando a implementação de estratégias de alta disponibilidade e recuperação rápida.

Considerações sobre adoção e melhores práticas

Antes de adotar containers para microsserviços, a avaliação de compatibilidade é fundamental. As aplicações existentes precisam ser compatíveis com a virtualização em containers, considerando dependências, versões de bibliotecas e configurações específicas. Além disso, a segurança deve estar no centro da estratégia, com a implementação de políticas de controle de acesso, segmentação de redes, utilização de imagens seguras e atualizadas, além de configurar regras de firewall para proteger ambientes internos.

O gerenciamento eficiente exige o uso de plataformas de orquestração, como Kubernetes, para automatizar implantação, escalonamento, atualizações e gerenciamento de falhas. Essas ferramentas facilitam a manutenção de ambientes de grande escala, garantindo alta disponibilidade e resiliência. A adoção de práticas de infraestrutura como código (IaC), por meio de ferramentas como Terraform ou Ansible, permite que toda a infraestrutura seja versionada e reproducível, promovendo maior controle, segurança e facilidade de auditoria.

Para garantir uma operação contínua, monitoramento avançado utilizando Prometheus, Grafana e ELK Stack é essencial. Além do monitoramento do desempenho e uso de recursos, é importante praticar backups regulares de volumes persistentes e implementar testes automatizados nas pipelines de CI/CD para detectar possíveis falhas antes do lançamento para produção.

Impacto na transformação digital e na infraestrutura moderna de TI

O uso de containers na implementação de microsserviços redefine a infraestrutura de TI, tornando-a mais flexível, ágil e orientada à automação. Empresas que realizam essa adoção conseguem diminuir significativamente o tempo entre o desenvolvimento e a produção, promovendo ciclos de inovação mais curtos. A escalabilidade sob demanda, aliada ao uso de ambientes híbridos e multi-cloud, potencializa a capacidade de responder rapidamente às mudanças de mercado, às solicitações dos clientes e às novas oportunidades de negócios.

Além disso, a capacidade de gerenciar milhares de microsserviços em containers permite maior desacoplamento dos componentes do sistema, melhorando a manutenção e atualização contínua. Essa abordagem promove uma cultura de automação e inovação contínua, essenciais para a competitividade no cenário tecnológico atual.

Perspectivas de futuro e tendências

O futuro da utilização de containers está intrinsecamente ligado à evolução de orquestradores como Kubernetes, que continuarão a aprimorar recursos de autoescala, gerenciamento automatizado de atualizações sem downtime, segurança integrada e suporte para ambientes multicloud complexos. A tendência é que o uso de containers se transforme em uma das peças centrais da infraestrutura de TI, integrando-se cada vez mais com inteligência artificial, automação de processos e análises preditivas.

Processos automatizados de compliance, políticas de segurança automatizadas e monitoramento inteligente se tornarão padrão, garantindo ambientes mais seguros, auditáveis e eficientes. A padronização de imagens, o fortalecimento de registries privados com controles de acesso granulares e o uso de soluções de monitoramento integradas serão essenciais para maximizar os benefícios dessa tecnologia.

Para as organizações que investem na modernização de suas infraestruturas, a adoção contínua de containers e orquestração será um diferencial estratégico, promovendo maior agilidade, inovação e resiliência diante de um mercado cada vez mais dinâmico e exigente.

O avanço contínuo de tecnologias de virtualização transformou profundamente a infraestrutura de TI, criando possibilidades que antes eram consideradas inalcançáveis. Os containers surgem nesse cenário como uma evolução significativa na forma de empacotar, distribuir e gerenciar aplicações e seus ambientes, criando um novo paradigma de agilidade, eficiência e modularidade. Para empresas e profissionais de TI, compreender as perspectivas futuras e as melhores práticas na adoção de containers é fundamental para manter-se competitivo e inovador.

Impactos na infraestrutura de TI e na transformação digital

Com a expansão do uso de containers, a infraestrutura de TI torna-se mais flexível ao possibilitar arquiteturas altamente escaláveis e resilientes. A modularidade dos containers permite dividir aplicações complexas em microsserviços independentes que podem ser implantados, atualizados e escalados de forma automatizada, reduzindo tempos de deploy e facilitando a manutenção contínua. Essas características fomentam uma cultura de inovação contínua, onde a agilidade na entrega de valor ao cliente se torna uma vantagem competitiva incontestável.

Além do mais, a integração de containers com plataformas de orquestração, como Kubernetes, promove automação avançada na gestão de ambientes, permitindo que empresas gerenciem milhares de containers em clusters multidimensionais. Essa automação acompanha as tendências de automação de processos aliada à inteligência artificial, elevando o nível de eficiência operacional.

Transformação na forma de desenvolvimento e implantação

Persistindo na linha de inovação, os containers potencializam significativamente as metodologias de desenvolvimento ágil, especialmente quando aliados às práticas DevOps e infraestrutura como código (IaC). Ferramentas como Docker, Kubernetes, Terraform, Ansible e outros passaram a ser componentes essenciais na construção de pipelines automáticos de CI/CD, onde o empacotamento, testes, validações e deployments ocorrem de forma contínua e controlada.

Essa integração permite que equipes de desenvolvimento possam liberar atualizações com maior frequência, com menor risco de falhas e maior compatibilidade entre ambientes de desenvolvimento, testes, homologação e produção. Assim, toda a cadeia de valor da TI se torna mais rápida, segura e eficiente, atendendo às demandas de mercados que evoluem rapidamente e exigem inovação constante.

Ferramentas e ambientes de orquestração: o que esperar?

Na visão futurista, os ambientes de orquestração como Kubernetes continuarão a evoluir, incorporando recursos de autoescala, recuperação automatizada, gerenciamento inteligente de recursos e suporte a ambientes multicloud de larga escala. Essa evolução consolidará os containers como base de uma infraestrutura distribuída, flexível e segura, que se adapta de forma dinâmica às necessidades do negócio.

Ferramentas complementares, como Docker Swarm, OpenShift, Rancher, EKS, GKE e AKS, irão ampliar o campo de possibilidades, oferecendo interfaces gráficas mais intuitivas, integrações facilitadas com plataformas de CI/CD e maior suporte à segurança e compliance. Essas plataformas estarão cada vez mais integradas a soluções de inteligência artificial, permitindo a previsão de falhas, otimização de recursos e automação de processos complexos.

Segurança, monitoramento e manutenção em ambientes de containers

Os ambientes de containers exigem uma abordagem de segurança proativa e contínua. Apadando-se às práticas recomendadas, é fundamental manter as imagens atualizadas, realizar varreduras de vulnerabilidade regularmente e aplicar políticas de acesso restritivas, além de segmentar redes para isolar ambientes críticos. Ferramentas de segurança específicas de containers, como Falco, Aqua Security e Prisma Cloud, estarão cada vez mais sofisticadas, oferecendo proteção contra ameaças emergentes.

Monitoramento também evoluirá com dashboards inteligentes, que integrados com Prometheus, Grafana e plataformas de análise de logs, fornecerão visibilidade em tempo real de tudo que ocorre no ambiente de containers. Essas soluções permitirão ações automatizadas de correção, ajustes de recursos sob demanda e análises preditivas de falhas antes que causem impactos sérios ao sistema.

A automação de backups e políticas de recuperação serão componentes essenciais para garantir disponibilidade de dados e continuidade operacional, especialmente em ambientes de alta escala e missão crítica.

Perspectivas futuras na integração de containers com tecnologias emergentes

O futuro aponta para uma integração cada vez mais estreita entre containers, inteligência artificial e automação de processos. A implementação de clusters inteligentes que aprendem com o uso de IA será capaz de ajustar recursos, otimizar custos e detectar ameaças de segurança em tempo real, com intervenção mínima humana.

Além disso, a adoção de soluções de registry privado, controle de acesso granular e padronizações de imagens garantirão ambientes mais seguros, auditáveis e em conformidade com regulações específicas, tornando a tecnologia de containers uma peça central na governança de TI moderna.

Conclusão

Ao consolidar conhecimentos sobre containers, sua evolução e seu futuro, empresas podem transformar completamente seus modelos de operação. Implementar uma infraestrutura baseada em containers modular, segura e automatizada promove maior agilidade, inovação e resiliência, essenciais para inovar e competir em um mercado cada vez mais digital e dinâmico. Para facilitar essa jornada, contar com suporte especializado de plataformas e provedores de confiança, como a Valuehost, é uma estratégia inteligente, garantindo infraestrutura robusta e pronta para os desafios do presente e do futuro.