Dentro do universo de tecnologia da informação, um dos conceitos mais relevantes para a operação de sistemas, servidores e páginas na web é o uptime. Essa métrica indica o período em que um serviço está ativo e disponível para os usuários, sendo fundamental para garantir a continuidade, confiabilidade e performance de uma presença digital. Quando uma companhia busca servidores confiáveis e uma experiência de navegação sem interrupções, ela está, na prática, investindo no aumento do seu uptime.

Para entender a importância do uptime, é essencial compreender que, na prática, esse indicador reflete o tempo total em que um sistema permanece operacional, em comparação com o tempo total considerado. Quanto mais próximo do 100%, maior a disponibilidade do serviço, minimizando riscos de perdas financeiras, insatisfação do cliente e danos à reputação. Empresas que atuam em e-commerce ou serviços online dependem de altos índices de uptime, pois uma queda momentânea pode significar vendas perdidas, clientes insatisfeitos ou até problemas legais.

O valor de uptime costuma ser expresso em porcentagens, sendo as mais citadas as certificações SSL, que garantem 99,9% (Nível de alta disponibilidade), e SLAs de até 99,999%, muito utilizados em ambientes críticos, como bancos e operadoras de saúde. Essas altas taxas representam que o sistema pode ficar, por exemplo, apenas alguns minutos fora do ar por mês, garantindo uma experiência quase incontestável aos usuários.

Embora pareça uma métrica simples, o cálculo do uptime envolve uma análise detalhada da disponibilidade do sistema ao longo do tempo. Essa medida é vital para empresas que buscam oferecer um serviço confiável, especialmente na era digital, onde a velocidade e a estabilidade são diferenciais competitivos. Além disso, a satisfação do cliente, a retenção de usuários e a otimização para mecanismos de busca (SEO) estão diretamente relacionadas ao uptime.

Na prática, manter um alto uptime exige estratégias e tecnologias específicas, incluindo infraestrutura robusta, monitoramento contínuo e práticas de manutenção preventiva. Essa base sólida é o que diferencia provedores de hospedagem de qualidade, como o ValueHost, que prioriza a alta disponibilidade como um dos pilares de seus serviços, garantindo que gestores e empresas possam concentrar suas operações sem se preocupar com quedas inesperadas.

Portanto, entender e gerenciar o uptime não é apenas uma questão técnica, mas uma estratégia de negócios essencial. Investir na confiabilidade do sistema é garantir que clientes tenham uma experiência satisfatória, que a reputação da marca seja sólida e que os resultados comerciais sejam positivos. Além disso, um bom índice de uptime influencia diretamente nas avaliações de desempenho feitas por plataformas de análise, além de melhorar o posicionamento nos resultados de busca do Google, fortalecendo a presença digital da empresa.

Como garantir alta disponibilidade com estratégias eficientes

Manter um alto índice de uptime não depende exclusivamente da infraestrutura física, mas também de uma gestão eficiente e de estratégias bem definidas que visam prevenir e mitigar potenciais problemas. Empresas que atuam com serviços digitais enfrentam uma variedade de desafios, como falhas de hardware, ataques cibernéticos ou simplesmente erros humanos durante operações de manutenção. Para minimizar esses riscos, a implementação de boas práticas de gerenciamento e investimentos adequados em tecnologia de ponta são fundamentos essenciais.

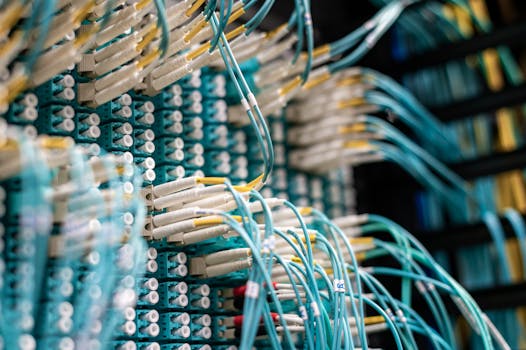

Uma das primeiras ações é a adoção de uma arquitetura de sistemas com redundância. Isso significa distribuir os recursos em vários servidores e centros de dados, de modo que, se um componente apresentar falha, outro possa assumir imediatamente, garantindo a continuidade do serviço. Essa estratégia, frequentemente utilizada por provedores como a ValueHost, reduz drasticamente o tempo de inatividade e melhora o uptime global.

Outra prática fundamental é o monitoramento constante. Ferramentas de monitoramento de uptime, que serão detalhadas posteriormente, permitem identificar possíveis problemas antes que afetem os usuários finais. Com alertas em tempo real, equipes de suporte podem agir rapidamente, realizando ajustes ou manutenções preventivas, evitando assim paradas não planejadas.

Além disso, é indispensável realizar uma manutenção preventiva regular nos sistemas. Isso inclui a atualização de softwares, substituição de componentes com alto risco de falha e revisão de backups. Esses procedimentos garantem que a infraestrutura se mantenha operacional e segura, além de minimizar vulnerabilidades que poderiam causar downtime.

Para empresas que dependem de plataformas web de alta performance, a implementação de soluções de balanceamento de carga também é uma técnica eficiente. Essa abordagem distribui o tráfego entre vários servidores, assegurando que nenhum fique sobrecarregado. Com isso, mesmo em períodos de pico, a experiência do usuário permanece fluida e o uptime é preservado.

Existem ainda certificações internacionais e padrões que indicam níveis elevados de confiabilidade e disponibilidade, como os certificados ISO 27001 ou as certificações específicas de data centers com alta disponibilidade. Ao buscar um provedor de hospedagem, essas credenciais se tornam importantes critérios de avaliação, reforçando o compromisso com a continuidade dos serviços.

Por fim, o papel do suporte técnico especializado não pode ser subestimado. Uma equipe capacitada deve estar disponível 24 horas por dia, 7 dias por semana, para responder rápida e eficientemente às demandas e incidentes. Essa prontidão, aliada às melhores práticas de gestão de incidentes, faz toda a diferença na manutenção de um uptime elevado consistentemente

Investir em uma infraestrutura confiável, adotar práticas de manutenção preventiva e monitoramento contínuo são passos estratégicos que elevam o nível de disponibilidade de sistemas. Como resultado, empresas conseguem oferecer uma experiência estável ao usuário, fortalecer sua reputação online e garantir a continuidade de seus negócios. A alta disponibilidade, portanto, é uma combinação de tecnologia, gestão e comprometimento com a excelência operacional.

Como o uptime é medido

O cálculo do uptime envolve a mensuração exata do tempo em que um sistema ou servidor permanece operando, em comparação com o período total considerado. Para tanto, empresas especializadas utilizam métricas como o Tempo Médio Entre Falhas (MTBF) e o Tempo Médio para Reparos (MTTR). O MTBF indica a duração média entre duas falhas consecutivas, enquanto o MTTR mede o tempo médio para restaurar o funcionamento após uma falha. Essas métricas fornecem uma visão clara da confiabilidade da infraestrutura, ajudando a identificar pontos de fragilidade e a estabelecer melhorias contínuas.

Ferramentas de monitoramento automatizado desempenham papel fundamental nesse processo. Plataformas modernas oferecem análise em tempo real, geração de relatórios detalhados e alertas instantâneos ao detectar falhas ou degradação de desempenho. Esses recursos permitem às equipes de TI agir rapidamente, minimizando o tempo de inatividade e assegurando altos índices de disponibilidade.

Além do monitoramento contínuo, a realização de testes de estresse e simulações de falhas é uma prática recomendada. Essas ações ajudam a verificar a robustez da infraestrutura e a validar a eficiência dos planos de recuperação. Consequentemente, empresas que mantêm um controle rigoroso sobre esses indicadores alcançam maior confiabilidade e garantem que o uptime permaneça elevado, mesmo diante de cenários adversos.

Investimentos em tecnologias de redundância, como servidores espelhados, balanceadores de carga e failover automatizado, também refletem no resultado do monitoramento de uptime. Quanto mais preciso for o diagnóstico e a resposta às falhas, menor será o impacto na experiência do usuário final, sustentando a reputação de confiabilidade da marca.

Ao integrar esses sistemas de medição e monitoramento com uma gestão proativa, empresas conseguem não apenas detectar e corrigir problemas rapidamente, mas também antecipar possíveis falhas, evitando que afetem os usuários. Essa abordagem alinhada ao uso de plataformas confiáveis, como as oferecidas pelo ValueHost, é a base para garantir que o alto índice de uptime seja uma realidade diária, sustentando a competitividade e a satisfação dos clientes.

Ferramentas para monitorar o uptime

Para garantir a alta disponibilidade de servidores e sistemas, as empresas utilizam uma variedade de softwares e serviços especializados em monitoramento de uptime. Essas ferramentas fornecem uma visão detalhada do desempenho dos recursos de TI, permitindo ações proativas e correções imediatas em caso de incidentes.

Entre as opções mais utilizadas estão plataformas que oferecem monitoramento periódico, checando a disponibilidade do site, servidores ou aplicações em intervalos predefinidos. Elas verificam se o sistema está acessível, respondendo às requisições corretamente, e enviam alertas em tempo real caso detectem indisponibilidade ou lentidão.

Esses recursos geralmente permitem a configuração de registros de logs detalhados, que auxiliam na análise de causas raízes e na implementação de melhorias contínuas. Além disso, muitos desses softwares possuem dashboards intuitivos, onde gestores podem visualizar métricas históricas de uptime, identificar tendências e planejar ações de manutenção.

Ferramentas populares incluem plataformas de monitoramento como Uptime Robot, Pingdom, StatusCake, New Relic e Datadog. Elas oferecem recursos avançados como testes de múltiplas regiões, verificações de páginas específicas, métricas de tempo de resposta e integração com outros sistemas de gestão.

Implementar uma estratégia de monitoramento eficiente é fundamental para empresas que dependem de serviços online, pois possibilita a identificação rápida de problemas, aumenta a confiabilidade do sistema e minimiza o impacto de possíveis quedas na experiência do usuário. Assim, o ValueHost, por exemplo, investe em soluções de monitoramento de última geração para garantir sua alta disponibilidade e reforçar sua reputação no mercado.

Importância do uptime na estratégia digital

Manter um alto índice de uptime não é apenas uma questão técnica, mas uma estratégia decisiva na presença digital de uma marca. Quando um sistema ou site está disponível na maior parte do tempo, a experiência do usuário é positiva, reforçando a confiança na marca e facilitando a conversão de visitantes em clientes.

Além de influenciar diretamente na satisfação dos clientes, o uptime afeta de maneira significativa o posicionamento nos motores de busca. Ferramentas de SEO, como o Google, avaliam fatores relacionados à performance do site, incluindo sua estabilidade, velocidade de carregamento e disponibilidade. Quanto mais estável for o serviço, maior a chance de obter um bom posicionamento nas páginas de resultados.

Essa relação direta entre uptime e SEO é reforçada por estudos que apontam que websites com alta disponibilidade tendem a ter métricas superiores de permanência do usuário, menor taxa de rejeição e maior autoridade digital. Empresas que investem em infraestrutura de alta performance, suporte técnico eficiente e protocolos de segurança robustos, consolidam sua reputação e garantem uma base sólida para crescimento sustentável.

Para negócios que operam em setores críticos, como financeiro, saúde ou e-commerce, a manutenção do uptime é uma prioridade absoluta. Uma interrupção, mesmo que por poucos minutos, pode gerar perdas financeiras significativas, prejudicar a imagem da marca e até acarretar questões legais com clientes ou órgãos reguladores.

Por isso, o monitoramento contínuo, aliado a estratégias de redundância e planos de recuperação de desastres, transformam o uptime numa variável de sucesso para a estratégia digital de qualquer organização. Quanto mais eficiente essa gestão, maior será a confiança dos clientes, a credibilidade perante o mercado e a capacidade de sustentar operações complexas sem interrupções.

Como o uptime é monitorado na prática e a importância de ser proativo

O monitoramento do uptime não é uma atividade pontual, mas uma prática contínua que garante a estabilidade do sistema ao longo do tempo. As empresas que buscam manter altos índices de disponibilidade utilizam ferramentas específicas que verificam a saúde de seus servidores e aplicações em intervalos regulares, muitas vezes a cada poucos minutos ou até segundos. Essa rotina permite detectar qualquer inconsistência antes que ela se transforme em um problema sério, minimizando o impacto na experiência do usuário.

Além do monitoramento automatizado, a realização de testes periódicos de estresse e simulações de falhas tem se mostrado uma estratégia eficaz para avaliar a resiliência da infraestrutura. Ao simular uma situação de queda de servidor ou ataque cibernético, por exemplo, as equipes de suporte podem validar a eficácia de seus planos de contingência. Essa abordagem proativa facilita a identificação de pontos frágeis e possibilita o aprimoramento contínuo dos sistemas, garantindo que o uptime seja elevado mesmo em cenários adversos.

O valor de uptime muitas vezes é expresso por SLAs (Acordos de Nível de Serviço), que representam compromissos formais entre provedores de serviços e clientes. Um SLA que garante 99,999% de disponibilidade, por exemplo, permite uma janela de indisponibilidade extremamente restrita, equivalente a poucos minutos por ano. Empresas que oferecem esse nível de garantia normalmente empregam uma combinação de tecnologias avançadas, como data centers com múltiplas redundâncias, balanceadores de carga e failover automatizado, além de suporte técnico especializado 24/7.

Para reforçar o monitoramento, há também a utilização de dashboards em tempo real, onde gestores podem acompanhar métricas detalhadas de desempenho e disponibilidade. Esses sistemas exibem dados históricos, tendências e alertas instantâneos, possibilitando uma ação rápida em caso de anomalias. A integração dessas ferramentas com sistemas de automação e scripts de resposta automática pode reduzir ainda mais o tempo de reação — uma estratégia que assegura que eventuais falhas sejam corrigidas antes que afetem os usuários finais.

Outro aspecto importante na gestão do uptime é a escalabilidade da infraestrutura. Plataformas que adotam soluções de cloud computing oferecem a vantagem de ampliar os recursos de forma rápida e eficiente sempre que necessário, garantindo que o desempenho seja mantido sob alta demanda. Essa flexibilidade é fundamental para negócios que experimentam picos de tráfego ou ciclos sazonais, pois evita que o sistema fique sobrecarregado ou indisponível.

Por fim, é imprescindível que as empresas mantenham uma equipe de suporte técnico treinada e preparada para agir em qualquer situação de crise. O suporte deve estar disponível 24 horas por dia, com procedimentos bem definidos para atender incidentes e realizar manutenções corretivas ou preventivas. Assim, a combinação de tecnologias avançadas, processos bem estruturados e equipe preparada cria uma cultura de alta disponibilidade, indispensável para o sucesso no mercado digital atual.

Investir em treinamentos constantes, adoção de melhores práticas de gerenciamento e a utilização de plataformas confiáveis são ações que contribuem diretamente para o aumento do uptime. Essa postura não é apenas uma estratégia técnica, mas uma decisão de negócio que reforça a credibilidade perante clientes, parceiros e mecanismos de busca. Empresas que levam o uptime a sério consolidam uma reputação de confiabilidade e inovação, essenciais para se destacar em um mercado cada vez mais competitivo.

Como o uptime impacta diretamente na experiência do usuário e na estratégia digital

O uptime não é apenas uma métrica técnica, mas uma peça fundamental na construção da reputação digital de uma marca. Quando um site ou sistema apresenta alta disponibilidade, a experiência do usuário é positiva, sem interrupções que possam causar frustração ou desistência. Isso reforça a confiança na marca, aumenta o tempo de permanência e potencializa a conversão de visitantes em clientes.

Além disso, o impacto do uptime no SEO é inegável. Motores de busca, particularmente o Google, levam em consideração fatores relacionados à performance do site na hora de determinar sua posição nas páginas de resultados. Uma plataforma que apresenta baixa disponibilidade pode sofrer quedas no ranking, afetando sua visibilidade e, consequentemente, suas oportunidades de negócio.

A estabilidade do sistema também influencia na reputação perante os clientes e no relacionamento com parceiros. Empresas que garantem alta disponibilidade demonstram seriedade e comprometimento com o serviço oferecido, aspectos essenciais na fidelização e na atração de novos clientes. Assim, investir em uma infraestrutura capaz de sustentar elevado uptime é uma estratégia de longo prazo, que reforça a presença digital e cria vantagem competitiva.

Como o uptime é monitorado na prática e estratégias para ser proativo

O monitoramento contínuo é a base para garantir que o uptime seja elevado de forma consistente. Empresas especializadas utilizam ferramentas automatizadas que verificam a disponibilidade de sistemas em intervalos curtos, frequentemente a cada poucos segundos. Essas verificações abrangem desde o tempo de resposta até a resposta correta das aplicações, oferecendo uma visão detalhada do estado do ambiente de TI.

Ferramentas de monitoramento também geram dashboards com métricas históricas, tendências de desempenho e alertas instantâneos. Dessa forma, a equipe técnica consegue agir rapidamente ao detectar uma anomalia, prevenindo que problemas se transformem em downtime real. Essa abordagem proativa reduz o impacto de incidentes e mantém o sistema operacional com alta disponibilidade.

Outro aspecto importante é a realização de testes de estresse e simulações de falhas. Essas avaliações ajudam a validar a resistência da infraestrutura e a eficácia dos planos de recuperação. Realizar periodicamente esse tipo de teste permite identificar vulnerabilidades e implementar melhorias antes que uma falha real aconteça, reforçando a resiliência do sistema.

Investir em uma estratégia de monitoramento de ponta, combinada com planos de ação bem definidos, é indispensável para manter o uptime elevado. Para isso, é importante escolher provedores e soluções confiáveis, que ofereçam suporte técnico especializado e recursos avançados de automação e análise. Assim, mesmo sob condições adversas, a disponibilidade de seus sistemas permanece alta, promovendo uma experiência contínua e segura para os usuários.

Ferramentas de monitoramento essenciais para garantir o uptime

Existem diversas soluções tecnológicas que auxiliam na medição e na garantia do uptime, se tornando essenciais para empresas que dependem de plataformas online confiáveis. Softwares como Uptime Robot, Pingdom, StatusCake, New Relic e Datadog oferecem recursos robustos que atendem desde monitoramentos básicos até análises avançadas de desempenho.

Essas ferramentas realizam verificações periódicas na disponibilidade dos servidores ou páginas, enviando alertas imediatos sempre que uma indisponibilidade é detectada. Além disso, possibilitam o registro de logs detalhados, facilitando a análise de causas e a implementação de melhorias contínuas.

Os dashboards dessas plataformas exibem métricas visuais e relatórios históricos, permitindo aos gestores identificar padrões e fazer projeções estratégicas. Integram-se facilmente com outras ferramentas de gestão de incidentes, automação e suporte, criando um ecossistema eficiente de manutenção do uptime.

A adoção dessas soluções é vital para alinhar a infraestrutura às expectativas de alta disponibilidade exigidas pelo mercado digital, principalmente em setores onde a continuidade operacional é condição sine qua non. A ValueHost, por exemplo, oferece recursos avançados de monitoramento, garantindo que seus serviços mantenham elevados índices de uptime, protegendo a reputação e a satisfação dos clientes.

Impacto do uptime na confiabilidade, na confiança dos clientes e nos resultados de negócios

Quando o sistema está disponível quase o tempo todo, a percepção de confiabilidade aumenta significativamente perante os usuários. Essa consistência traz tranquilidade e fortalece a credibilidade da marca, elementos cruciais para fidelizar clientes e atrair novos negócios.

Além disso, o uptime elevado reflete positivamente nos resultados financeiros. Plataformas confiáveis reduzem perdas decorrentes de indisponibilidade, como vendas perdidas ou custos extras com suporte emergencial. Empresas que mantêm alta disponibilidade também desfrutam de melhor posicionamento em mecanismos de busca, pois plataformas estáveis tendem a apresentar melhores métricas de desempenho, aumentando sua autoridade digital.

Outro benefício importante é a possibilidade de ampliar operações de forma segura, especialmente com o uso de infraestrutura escalável na nuvem. Essa estratégia permite ajustar recursos conforme a demanda, evitando sobrecargas ou quedas, o que mantém o sistema confiável e disponível.

Por fim, a manutenção de um alto índice de uptime destaca uma cultura organizacional voltada para a excelência operacional. Empresas com uma gestão eficiente do tempo de atividade demonstram compromisso com a satisfação do cliente, inovação e diferenciação no mercado, o que se traduz em vantagens competitivas duradouras.

Boas práticas para otimizar ainda mais o uptime na sua infraestrutura

Para elevar o uptime ao máximo, é essencial adotar boas práticas de gestão e infraestrutura capazes de prevenir falhas e acelerar a recuperação em caso de incidentes. A escolha de provedores confiáveis, que oferecem recursos avançados de redundância, suporte técnico 24/7, e políticas de manutenção preventiva, é um ponto de partida fundamental.

Outra prática eficaz é fortalecer a arquitetura do sistema por meio de redundâncias, balanceamento de carga e failover automatizado. Essas medidas garantem que, se uma parte da infraestrutura falhar, o sistema continue operando normalmente, sem impacto perceptível aos usuários.

Atualizações constantes de softwares, controle rigoroso de vulnerabilidades e backup regular também contribuem para mitigar riscos de downtime. Além disso, a equipe de suporte deve estar treinada e preparada para agir rapidamente em qualquer situação, minimizando o tempo de reparo.

Implementar uma cultura de testes periódicos, treinamentos de resposta a incidentes e revisões contínuas das estratégias de disponibilidade reforçam a resiliência do sistema. Essas ações garantem que sua infraestrutura esteja sempre alinhada às melhores práticas do mercado, promovendo alta disponibilidade de forma consistente.

Ao seguir essas recomendações, sua organização não apenas aumenta seu índice de uptime, mas também fortalece sua imagem de marca confiável e inovadora, fatores essenciais no cenário competitivo digital de hoje.

Na busca por uma presença digital sólida, muitas empresas e responsáveis por projetos online percebem a importância de manter seus sites, aplicações e sistemas sempre ativos e acessíveis. Entretanto, compreender detalhadamente como essa disponibilidade é medida, garantida e otimizada é fundamental para estratégias de sucesso no ambiente digital atual. É neste cenário que o conceito de uptime ganha destaque, especialmente ao considerar a escolha de provedores de hospedagem, como o valor oferecido pelo ValueHost.

O conceito de uptime não se limita a um mero indicador técnico. Ele representa a porcentagem de tempo em que um sistema, site ou aplicação permanece disponível e operacional perante os usuários. Quanto maior esse índice, maior a confiabilidade do serviço. Para negócios, especialmente aqueles que operam na internet, altos níveis de uptime garantem uma experiência contínua aos visitantes,sem interrupções ou quedas inesperadas, refletindo diretamente na satisfação do cliente e na credibilidade da marca.

Entender os fatores que influenciam esse indicador permite que gestores tomem decisões estratégicas na infraestrutura de TI, visando minimizar riscos de downtime, ou seja, períodos de indisponibilidade. Além do mais, a medição adequada do uptime habilita a implementação de melhorias contínuas, criando uma cultura de alta disponibilidade e resiliência operacional. Nesse contexto, provedores de serviços de hospedagem que priorizam tecnologias de ponta, suporte especializado e planos de redundância — como o ValueHost — se destacam ao oferecer garantias de alta disponibilidade, essenciais para manter o sucesso de qualquer presença digital.

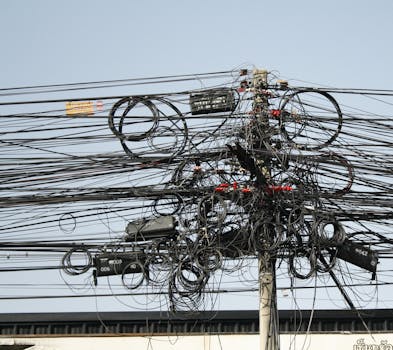

Para ilustrar o impacto de um uptime consistente, considere a experiência do usuário ao acessar uma loja virtual. Caso o site fique indisponível por poucos minutos, o cliente pode abandonar a compra, prejudicando a receita e a reputação da marca. Ou seja, mesmo pequenas interrupções podem gerar perdas financeiras consideráveis e abalar a confiança do consumidor. Por esse motivo, a implementação de uma infraestrutura confiável, com equipamentos de última geração, redes redundantes e centros de dados distribuídos geograficamente, é uma estratégia comum entre provedores de alta qualidade, como o ValueHost.

Outro aspecto importante na garantia de uptime é a adoção de ferramentas avançadas de monitoramento de sistemas. Elas oferecem uma visão em tempo real do desempenho da infraestrutura, identificando sinais precoces de potencial falha e permitindo ações preventivas. Essa vigilância constante, aliada a planos de resposta rápida e equipes treinadas, evita que problemas simples evoluam para paradas completas, assegurando uma disponibilidade contínua.

Além disso, a utilização de técnicas como balanceamento de carga, failover automatizado e replicação de dados reforça a resiliência do sistema. Assim, se um servidor apresentar uma falha, outro assume automaticamente, sem impacto para o usuário final. Essas estratégias fazem parte do pacote de serviços oferecidos por provedores de qualidade, facilitando a manutenção de um elevado índice de uptime.

Por fim, a análise de métricas contínuas é imprescindível. Ferramentas de relatórios, dashboards e SLAs (Acordos de Nível de Serviço) proporcionam uma visão detalhada do desempenho, ajudando a identificar tendências e áreas de melhoria. No cenário competitivo atual, empresas que dominam a gestão de uptime estão melhor posicionadas para oferecer serviços confiáveis, reforçando sua reputação perante os clientes e conquistando vantagem competitiva.

Ao compreender e investir na otimização do uptime, sua organização fortalece sua presença digital, reduz riscos de perdas e potencializa seus resultados comerciais. Seja ao escolher um provedor de hospedagem ou ao aprimorar sua infraestrutura, entender essa métrica garante que seus sistemas operem de forma contínua, confiável e eficiente, atendendo às expectativas mais elevadas do mercado.

A manutenção de um alto índice de uptime depende de diversos fatores que, se não controlados adequadamente, podem levar à indisponibilidade dos sistemas. Entre as principais causas de downtime, destacam-se falhas de hardware, que ocorrem devido ao desgaste de componentes, defeitos nos dispositivos ou falhas na infraestrutura física. Essas falhas podem ser mitigadas por políticas de manutenção preventiva, substituição programada de equipamentos e uso de componentes de alta qualidade, além de redundância física nos data centers.

Outro fator relevante é o erro humano, que, apesar de muitas vezes inadvertido, pode comprometer a operação do sistema, seja por configurações incorretas, atualizações mal planejadas ou ações não autorizadas. Para reduzir esse risco, a implementação de boas práticas, treinamentos constantes e procedimentos internos rigorosos tornam-se essenciais, além do uso de sistemas de automação que limitam a intervenção manual e minimizam a margem de erro.

Manutenções programadas, embora essenciais para a atualização e segurança do ambiente, representam um período de downtime planejado. A comunicação clara e o agendamento em horários de menor impacto ajudam a diminuir a insatisfação do usuário. Ainda assim, é necessário planejar essas ações com coordenadores de TI e equipes de suporte para evitar falhas não previstas e garantir uma rápida recuperação.

Ataques cibernéticos, como negação de serviço (DDoS), invasões, ransomware e outras ameaças, também representam uma grande ameaça à estabilidade do sistema, podendo ocasionar quedas abruptas ou lentidão severa. Investir em firewalls avançados, sistemas de detecção de intrusão, protocolos de segurança atualizados e planos de resposta a incidentes são ações que ajudam a proteger a infraestrutura contra esses riscos, preservando o uptime.

Desastres naturais, como tempestades, terremotos ou incêndios, podem causar interrupções físicas na infraestrutura de servidores e redes. A adoção de centros de dados distribuidos geograficamente, estratégias de recuperação de desastres e planos de continuidade de negócio são práticas indispensáveis para garantir a resiliência operacional.

Além de todos esses fatores, o envelhecimento da infraestrutura também impacta negativamente o uptime. A utilização de componentes antigos, desatualizados ou com alto risco de falha aumenta a vulnerabilidade a interrupções inesperadas. Realizar avaliações periódicas e substituições oportunas mantém a resiliência operacional da infraestrutura.

Portanto, a busca por um alto uptime é uma combinação de gerenciamento de riscos, implementação de tecnologias de ponta e uma cultura organizacional voltada para a prevenção de falhas. Empresas que adotam essas práticas, como a ValueHost, certamente se destacam no mercado pela confiabilidade de seus serviços e pela satisfação de seus clientes.

Eliminar completamente o risco de downtime pode ser impossível, mas a mitigação eficaz desses fatores constitui uma estratégia sólida de manutenção da alta disponibilidade. Assim, a seleção de fornecedores que oferecem infraestrutura robusta, suporte técnico dedicado e planos de redundância são essenciais para assegurar o funcionamento contínuo dos sistemas, principalmente em ambientes de alta criticidade.

Importância do uptime na estratégia digital

O uptime influencia diretamente na percepção de confiabilidade de uma marca perante seus clientes. Uma plataforma altamente disponível reforça a credibilidade, oferece uma experiência contínua ao usuário e reduz as chances de abandono por falhas técnicas. Além disso, em setores competitivos como comércio eletrônico, saúde ou serviços financeiros, a indisponibilidade por poucos minutos pode gerar impactos financeiros severos e prejudicar a reputação da empresa.

Outro aspecto essencial é o impacto na performance em mecanismos de busca. Os algoritmos do Google priorizam sites que apresentam bom desempenho, incluindo aspectos como velocidade de carregamento e estabilidade. Sites que enfrentam quedas frequentes podem sofrer penalizações de ranqueamento, reduzindo sua visibilidade orgânica e dificultando a atração de novos visitantes. Assim, alta disponibilidade e estabilidade consistentes contribuem para estratégias de SEO mais eficazes e para o fortalecimento da autoridade digital.

Na prática, negócios que operam principalmente no ambiente online dependem de sistemas que apresentem uptime elevado para garantir que os clientes tenham acesso contínuo aos serviços. Caso o sistema apresente downtime frequente ou prolongado, as perdas vão além do aspecto financeiro, afetando também a confiança do consumidor, a fidelidade à marca e a competitividade perante empresas que oferecem plataformas mais estáveis.

Estudos de mercado demonstram que empresas com altos índices de disponibilidade conseguem retenção de clientes significativamente maior e menores custos de suporte técnico emergencial. Além disso, uma infraestrutura de TI sólida, capaz de sustentar esse alto nível de uptime, favorece o crescimento sustentável do negócio, permitindo expansão, inovação e melhor posicionamento frente à concorrência.

Para garantir a continuidade operacional, diversas ações estratégicas podem ser adotadas. Entre elas, o uso de data centers distribuídos geograficamente e a implementação de tecnologias de redundância, como servidores espelhados, balanceadores de carga e failover automatizado. Essas medidas evitam que falhas isoladas provoquem o desligamento completo do sistema, reforçando o compromisso com a alta disponibilidade.

Um exemplo de sucesso na gestão de uptime é a implementação de uma cultura de testes e simulações contínuas, onde são realizados ataques controlados ou situações de falha para verificar a rapidez e a eficiência na recuperação do sistema. Essa prática identifica pontos frágeis antes que ocorram problemas reais, permitindo ajustes pontuais e melhorias constantes na infraestrutura.

Outro fator indispensável é o suporte técnico qualificado e disponível 24/7. Uma equipe treinada para atuar rapidamente em incidentes, acompanhada de protocolos de resposta bem definidos, é capaz de reduzir o MTTR (tempo médio de reparo) e, consequentemente, aumentar o uptime. Essa combinação de tecnologia, pessoas e processos forma a base de uma operação resiliente.

Com essas ações coordenadas, empresas como o ValueHost garantem que sua infraestrutura esteja sempre preparada para enfrentar desafios, minimizando riscos e mantendo alta disponibilidade de serviços. Assim, o uptime se torna uma vantagem competitiva, refletindo positivamente na experiência do usuário, na eficiência operacional e na reputação da marca.

Complementando essas estratégias, investir em políticas sólidas de backup e planos de recuperação de desastres é fundamental. Em caso de incidentes catastróficos, sistemas bem preparados conseguem restaurar operações com o menor impacto possível. Essa proatividade reforça não só o uptime, mas também a confiabilidade percebida pelos clientes, aumentando a fidelidade e a satisfação humanada na presença digital.

Por fim, o sucesso na manutenção de altos índices de uptime depende do alinhamento entre tecnologia, gestão de riscos e cultura organizacional. Empresas comprometidas em oferecer continuidade contínua estabelecem um padrão de excelência operacional, que se reflete na experiência do cliente, na autoridade no mercado e no crescimento sustentável do negócio.

Manter um alto índice de disponibilidade não depende apenas de tecnologias avançadas, mas também de uma gestão cuidadosa que minimize riscos. Entre as principais causas de downtime estão as falhas de hardware, que podem ocorrer devido ao desgaste de componentes, defeitos na infraestrutura ou falhas em dispositivos essenciais. Para mitigar esses fatores, empresas de hospedagem e gestores de TI investem em políticas de manutenção preventiva, troca programada de equipamentos e na utilização de componentes de alta qualidade. A implementação de redundâncias físicas e geográficas reforça ainda mais essa resistência, garantindo que a indisponibilidade seja minimizada ao máximo.

Erro humano também figura entre os fatores que podem reduzir o uptime. Configurações incorretas, atualizações mal planejadas ou intervenções não autorizadas podem gerar falhas que impactam a disponibilidade do sistema. Para evitar esses incidentes, é fundamental estabelecer procedimentos internos rígidos, treinamentos constantes para as equipes e a automação de processos críticos. Além disso, o uso de sistemas de automação que limitam intervenções manuais ajuda a reduzir a margem de erro, garantindo maior estabilidade operacional.

As manutenções programadas, embora essenciais à segurança e atualização do sistema, representam períodos de downtime planejado. O sucesso nesse aspecto está na comunicação clara com os clientes, no agendamento em horários de menor impacto e na execução eficiente das ações de manutenção. Planejar essas atividades em parceria com equipes de TI e suporte garante uma rápida recuperação, além de preservar a experiência do usuário.

Outro aspecto relevante é a atuação de ataques cibernéticos, que podem provocar quedas abruptas ou lentidão severa dos sistemas. Investir em firewalls atualizados, sistemas de detecção de intrusões, protocolos de segurança robustos e planos específicos de resposta a incidentes ajuda a proteger a infraestrutura. Além disso, ameaças naturais como tempestades, terremotos ou incêndios podem afetar centros de dados físicos. A adoção de centros de dados distribuídos geograficamente, planos de recuperação de desastres e estratégias de continuidade de negócio são medidas essenciais para garantir a resiliência e a alta disponibilidade dos serviços.

Também deve-se considerar o envelhecimento natural da infraestrutura, pois componentes desatualizados ou com alto risco de falha aumentam significativamente as chances de downtime. Avaliações periódicas, substituições oportunas e a adoção de tecnologias modernas e de alta confiabilidade são práticas que mantêm a infraestrutura robusta, reforçando a resiliência operacional.

Portanto, a gestão eficaz de fatores como falhas de hardware, erro humano, ataques cibernéticos, desastres naturais e envelhecimento da infraestrutura configura a base para a manutenção de um alto índice de uptime. Empresas especializadas, como o ValueHost, dedicam-se a oferecer ambientes de alta disponibilidade com estratégias integradas que minimizam riscos, garantindo que seus sistemas permaneçam operando de forma contínua e confiável.